اعتمد البيت الأبيض قواعد جديدة بشأن استخدام الذكاء الاصطناعي من قبل وكالات الأمن القومي والتجسس الأمريكية، تهدف إلى تحقيق توازن بين الإمكانيات الهائلة لهذه التكنولوجيا والضرورة الملحة للحماية من مخاطرها.

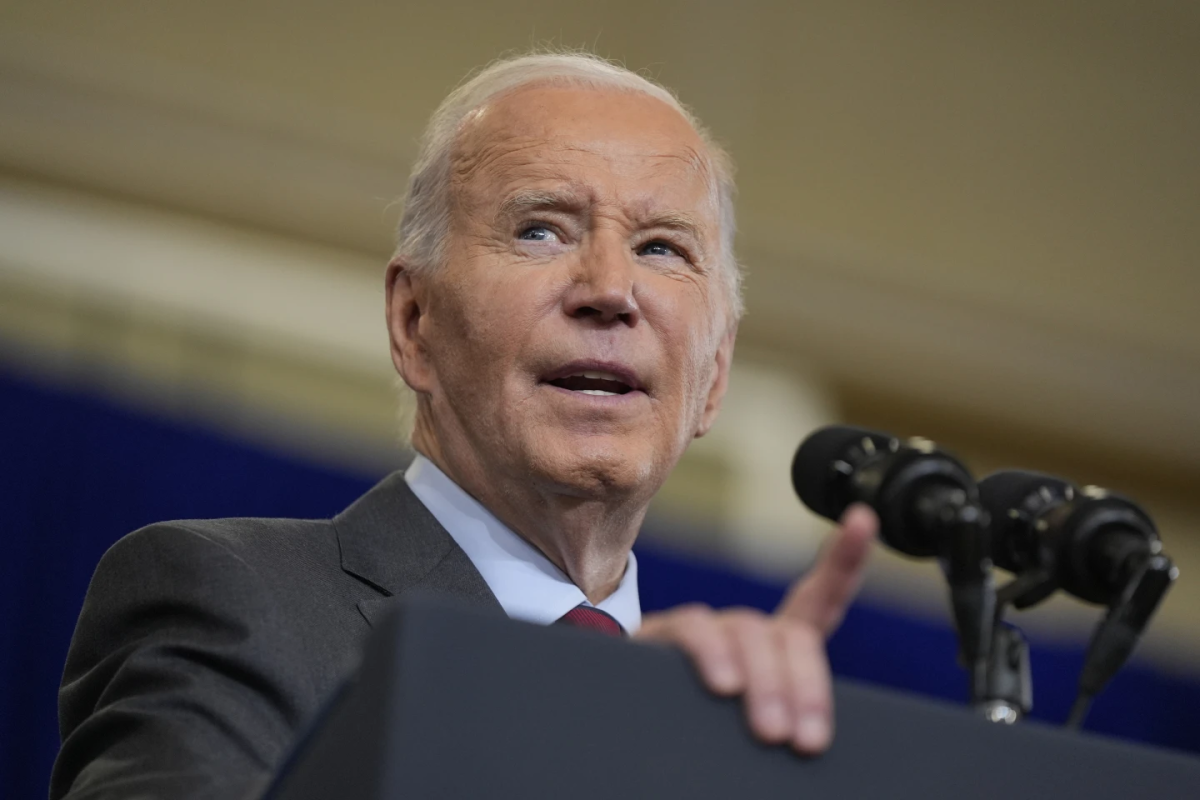

الإطار الذي وقعه الرئيس جو بايدن وتم الإعلان عنه يوم الخميس يهدف إلى ضمان قدرة وكالات الأمن القومي على الوصول إلى أحدث وأقوى أنظمة الذكاء الاصطناعي، مع التخفيف من مخاطر إساءة استخدامها.

لقد حظيت التقدمات الأخيرة في الذكاء الاصطناعي بإشادة واسعة، حيث يُنظر إليها كتحول محتمل للعديد من الصناعات والقطاعات، بما في ذلك العسكرية والأمن القومي والاستخبارات. ومع ذلك، هناك مخاطر مرتبطة باستخدام الحكومة لهذه التكنولوجيا، مثل إمكانية استخدامها في المراقبة الجماعية أو الهجمات الإلكترونية أو حتى الأسلحة المستقلة القاتلة.

وقال جاك سوليفان، مستشار الأمن القومي، أثناء وصفه السياسة الجديدة للطلاب خلال ظهوره في جامعة الدفاع الوطني في واشنطن: "هذه هي الاستراتيجية الأولى في تاريخ أمتنا لاستغلال قوة الذكاء الاصطناعي وإدارة مخاطره من أجل تعزيز أمننا القومي".

يوجه الإطار وكالات الأمن القومي إلى توسيع استخدام أنظمة الذكاء الاصطناعي المتقدمة، مع حظر بعض الاستخدامات، مثل التطبيقات التي تنتهك الحقوق المدنية المحمية دستورياً أو أي نظام يقوم بأتمتة نشر الأسلحة النووية.

تشجع بعض البنود على البحث في مجال الذكاء الاصطناعي وتدعو إلى تعزيز أمان سلسلة إمدادات الرقائق الإلكترونية في البلاد. كما توجه القواعد وكالات الاستخبارات لإعطاء الأولوية لحماية الصناعة الأمريكية من حملات التجسس الأجنبية.

تابعت منظمات حقوق الإنسان عن كثب الاستخدام المتزايد للذكاء الاصطناعي من قبل الحكومة، وعبرت عن قلقها من إمكانية إساءة استخدام هذه التكنولوجيا.

وأفادت الرابطة الأمريكية للحريات المدنية يوم الخميس بأن الحكومة تمنح وكالات الأمن القومي صلاحيات تقديرية كبيرة، مما يمكنها من "مراقبة نفسها".

وذكر باتريك تومي، نائب مدير مشروع الأمن القومي في الرابطة، قائلاً: "على الرغم من الاعتراف بالمخاطر الكبيرة للذكاء الاصطناعي، إلا أن هذه السياسة لا تذهب بعيدًا بما يكفي لحمايتنا من أنظمة الذكاء الاصطناعي الخطرة وغير القابلة للمسائلة. إذا كانت تطوير أنظمة الذكاء الاصطناعي للأمن القومي أولوية ملحة للبلاد، فإن اعتماد تدابير حماية حقوق الخصوصية أمر ملح بنفس القدر".

تم وضع هذه الإرشادات عقب توقيع بايدن على أمر تنفيذي طموح العام الماضي دعا فيه الوكالات الفيدرالية إلى وضع سياسات حول كيفية استخدام الذكاء الاصطناعي.

قال المسؤولون إن القواعد مطلوبة ليس فقط لضمان الاستخدام المسؤول للذكاء الاصطناعي، ولكن أيضًا لتشجيع تطوير أنظمة جديدة وضمان بقاء الولايات المتحدة في مقدمة المنافسة مع الصين وخصوم آخرين يسعون أيضًا لاستغلال قوة هذه التكنولوجيا.

قال سوليفان إن الذكاء الاصطناعي يختلف عن الابتكارات السابقة التي تم تطويرها بشكل كبير من قبل الحكومة، مثل استكشاف الفضاء والإنترنت والأسلحة النووية. بل إن تطوير أنظمة الذكاء الاصطناعي كان يقوده القطاع الخاص.

وأضاف: "الآن، هو في وضع يؤهله لتحويل مشهد أمننا القومي".

مدح العديد من الشخصيات في صناعة الذكاء الاصطناعي، الذين تواصلت معهم وكالة أسوشيتد برس، السياسة الجديدة، معتبرين أنها خطوة أساسية لضمان عدم فقدان الولايات المتحدة لميزتها التنافسية أمام الدول الأخرى.

قال كريس هاتر، رئيس قسم أمن المعلومات في شركة Qwiet.ai، وهي شركة تكنولوجيا تستخدم الذكاء الاصطناعي للكشف عن نقاط الضعف في الشفرات البرمجية، إنه يعتقد أن السياسة يجب أن تحظى بدعم من كلا الحزبين.

بدون سياسة واضحة، قد تتخلف الولايات المتحدة في "أهم تحول تكنولوجي في عصرنا".

وأضاف هاتر: "الإمكانات ضخمة. في العمليات العسكرية، سنشهد استخدام الأسلحة المستقلة، مثل الطائرات المقاتلة F-16 والطائرات بدون طيار المدعومة بالذكاء الاصطناعي، بالإضافة إلى أنظمة دعم القرار التي تعزز الذكاء البشري".

أوضح سوليفان أن الذكاء الاصطناعي يعيد تشكيل كيفية إدارة وكالات الأمن القومي للوجستيات والتخطيط، وتحسين الدفاعات السيبرانية، وتحليل المعلومات الاستخباراتية. وقد تظهر تطبيقات أخرى مع تطور التكنولوجيا، حسب قوله.

تظل الطائرات بدون طيار القاتلة، القادرة على القضاء على عدو بناءً على قرارها الخاص، مصدر قلق رئيسي بشأن الاستخدام العسكري للذكاء الاصطناعي. العام الماضي، أصدرت الولايات المتحدة إعلانًا يدعو إلى التعاون الدولي لوضع معايير للطائرات بدون طيار المستقلة.